Proveniência Digital para Verificação de Conteúdo

Em resposta aos fraudadores que utilizam a inteligência artificial generativa para enganar ou difamar, empresas de tecnologia estão implementando métodos para ajudar os usuários a verificar o conteúdo, especialmente imagens estáticas. Como parte de sua estratégia de combate à desinformação de 2024, a OpenAI está incluindo metadados de proveniência em imagens geradas com o ChatGPT na web e na API DALL-E 3, com seus equivalentes móveis recebendo o mesmo upgrade até 12 de fevereiro.

Padrão Aberto de Proveniência de Conteúdo

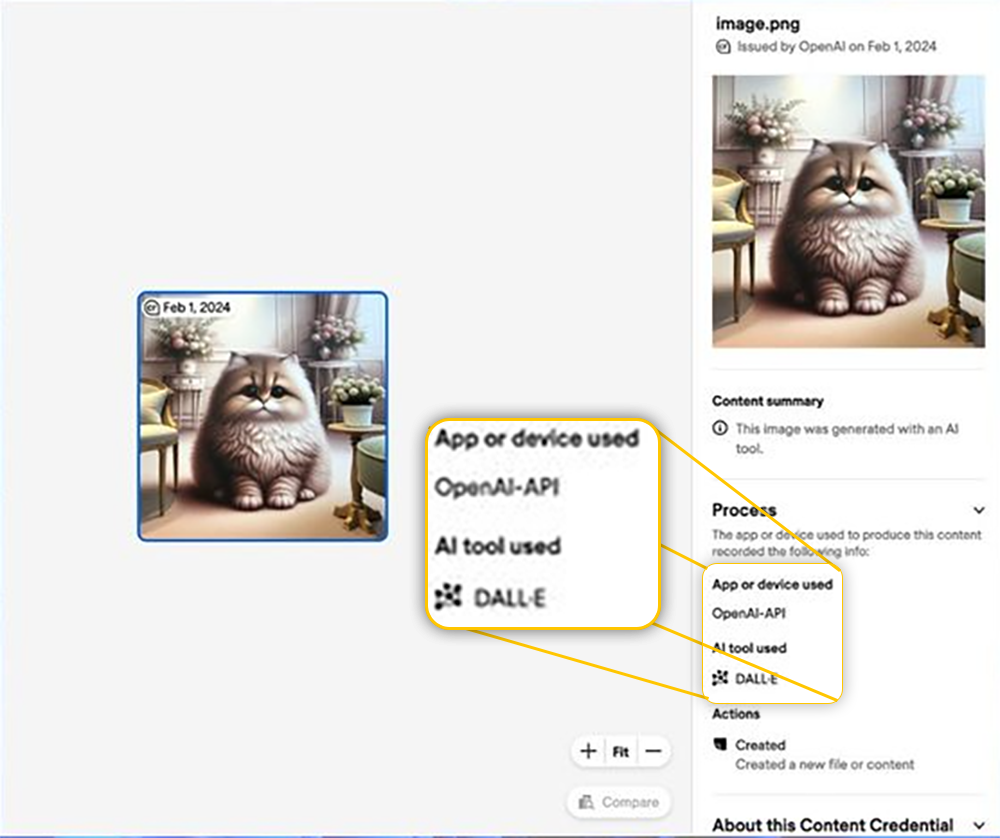

Os metadados seguem o padrão aberto da C2PA (Coalition for Content Provenance and Authenticity), e ao carregar uma imagem gerada com esse método para a ferramenta de verificação de credenciais de conteúdo, você poderá rastrear sua linhagem de proveniência.

Por exemplo, uma imagem gerada usando o ChatGPT mostrará um manifesto inicial de metadados indicando sua origem na API DALL-E 3, seguido por um segundo manifesto de metadados mostrando que ela surgiu no ChatGPT.

Limitações e Desafios

Apesar da tecnologia criptográfica sofisticada por trás do padrão C2PA, este método de verificação só funciona quando os metadados estão intactos; a ferramenta não é útil se você carregar uma imagem gerada por IA sem metadados – como é o caso de qualquer captura de tela ou imagem enviada nas redes sociais. Não é surpresa que as imagens de amostra atuais na página oficial do DALL-E 3 também tenham retornado em branco. Em sua página de perguntas frequentes, a OpenAI admite que isso não é uma solução perfeita para combater a guerra da desinformação, mas acredita que a chave está em incentivar os usuários a procurar ativamente por tais sinais.

Avanços e Perspectivas Futuras

Embora os esforços mais recentes da OpenAI para combater conteúdo falso estejam atualmente limitados a imagens estáticas, o DeepMind do Google já possui o SynthID para marcar digitalmente tanto imagens quanto áudio gerados por IA. Enquanto isso, o Meta tem testado marcações invisíveis por meio de seu gerador de imagens de IA, o que pode ser menos suscetível a adulterações.